La théologie génocidaire de l’empire

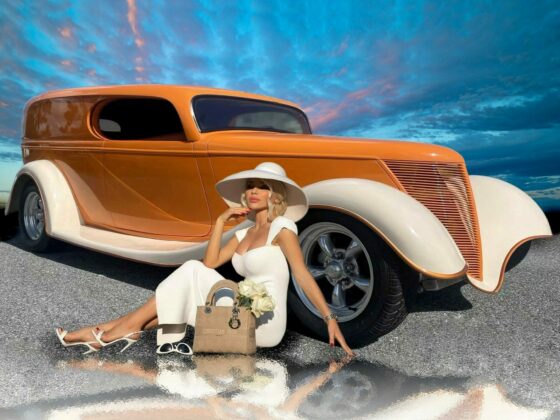

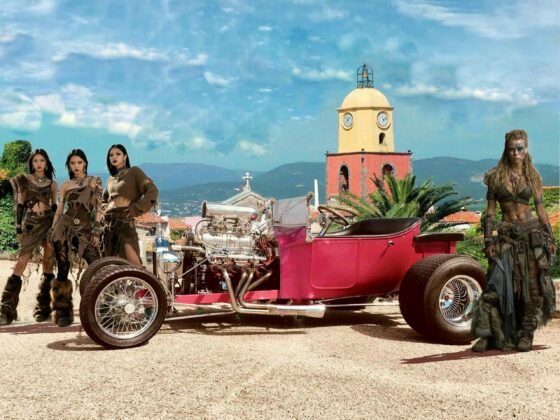

Même pour les Hot Rodders férus de “Fuel the Fire, Ride or Die”, slogan qui est aussi l’accroche de l’abonnement à mes Web-Sites mettant en scène des V8 Big-Bloc avec Blower, l’arrivée de l’IA dans nos vies est l’événement le plus important de l’histoire. Sans négliger les aspects positifs, les érudits considèrent aussi le côté eschatologique de l’affaire. Mais, comme tout part “en couilles”, il faut aussi s’attendre au développement d’une IA potentiellement très hostile (unfriendly)… Déjà en 2000, Bill Joy, inventeur du système “Java”, s’interrogeait : “Pourquoi le futur n’aura-t-il plus besoin de nous, les humains ?”. C’est l’irruption du complexe dit de “Frankenstein”, forgé par l’auteur de science fiction Isaac Asimov, qui est la cause de ce négativisme, car il s’est inspiré du roman “Frankenstein ou le Prométhée moderne” (1818) de Mary Shelley, mettant en scène une créature se retournant contre son créateur, le punissant ainsi de l’impudence de s’être hissé à la hauteur de Dieu en recréant la vie… Waouwwww !. C’est exactement la doctrine Juive mise en réalité par ce fou furieux de Netanayou… La récente publication de fichiers piratés des services du renseignement israéliens, a fait plus que confirmer les craintes. Elle les a mis en évidence de manière flagrante.

La soi-disant “Option Samson”, longtemps qualifiée par les apologistes de mythe ou de simple mesure de dissuasion hypothétique, est désormais exposée au grand jour sous sa forme opérationnelle, avec une liste de cibles nucléaires, des détails sur la puissance des frappes et une carte mondiale des zones à détruire. Il ne s’agit pas d’une théorie abstraite, mais d’une intention stratégique froide et calculée… Et cette intention est l’anéantissement de la planère “Terre”... Dans le cadre de l’option Samson, Israël se réserve le “droit” de lancer des attaques nucléaires non seulement contre ses agresseurs directs, mais aussi contre tout pays qu’il juge complice de sa chute, une doctrine qui transforme la neutralité, la retenue, voire la critique en actes de guerre. En clair : si Israël s’effondre, le reste du monde doit suivre. Ce n’est pas de la défense, c’est un pacte suicidaire imposé à la planète, en commençant par les métropoles mondiales, de Téhéran à Pékin, du Caire à Moscou, de Berlin à New York, considérées comme des dommages collatéraux acceptables dans ce pari apocalyptique… Ce à quoi nous assistons actuellement, n’est donc pas juste une doctrine militaire, c‘est une extorsion génocidaire, minutieusement calibrée pour protéger un projet colonialiste de toute responsabilité. Elle redéfinit la survie de l’État comme un droit incontestable à la dévastation mondiale.

Elle met le monde au défi d’intervenir, le narguant en promettant de tout incinérer si quelqu’un ose s’y risquer. Ce n’est pas de la dissuasion, c’est une prise d’otage à l’échelle nucléaire. Une doctrine forgée non pas sur la raison, mais sur la suprématie, la vengeance et la paranoïa existentielle transformées en arme politique d’État. L’Option Samson transforme un traumatisme historique en une justification grotesque pour de futurs holocaustes… Elle déclare : “Notre mort sera la vôtre. Notre échec sera votre ruine”… Le nom de cette doctrine lui va comme un gant. Dans le récit biblique, Samson fait s’écrouler le temple sur ses ennemis, mais périt dans les décombres. La version sioniste moderne détourne ce mythe pour en faire une parabole planétaire : le temple représente désormais la Terre elle-même. Les ennemis sont tous ceux qui osent défier l’apartheid. Et l’objectif n’est pas la paix, mais la soumission écrasante du monde sous la botte nucléaire Israélienne. C’est la théologie génocidaire de l’empire, désormais façonnée en missiles et en plans d’attaque avec une précision chirurgicale. Le voile est levé… En 1921, le dramaturge tchèque Karel Capek dans sa pièce “Rossum’s Universal Robots”, a créé le terme de “Robot” (qui en tchèque signifie : corvée, servitude) et a remis en scène d’écritures ce ressort dramatique.

Le jeune Isaac Asimov, considérant les machines uniquement comme telles et las de la récurrence “ab nauseam” de ce scénario, a décidé de créer des machines rassurantes en utilisant l’artifice des lois de la robotique : “Trois lois plus une loi zéro” (Runaround, 1942)… Ce sera le fil conducteur de trente cinq nouvelles et cinq romans sur les robots ! Isaac Asimov considérait ce concept comme le plus influent de son œuvre. Seulement, ses lois de la robotique qui avaient pour objet de réduire le fantasme, l’ont au contraire grandement alimenté. Jugées inopérantes dans le réel, elles ne sont pas prises au sérieux dans le champ de l’IA, l’abstraction qu’elles induisent rendant difficile voire impossible leur implémentation dans un programme. Malgré tout, les prétendues lois d’Isaac Asimov contrecarraient, dans la fiction, la prise de pourvoir par les machines et inspiraient “l’éthique des machines” qui émergera dans les années 2000. Jusqu’alors la relation entre l’éthique et la technologie portait sur la responsabilité ou l’irresponsabilité humaine, quoique certains, plus aventureux, interrogeaient la manière de traiter les machines. Dans les deux cas, seul l’humain était engagé dans une démarche éthique. Dans une perspective troublante, l’éthique des machines visait alors à créer des agents intelligents qui auraient un comportement “moral” vis-à-vis des humains et des machines.

C’était un rêve qui s’est transformé en cauchemar dès l’instant ou les gentils robots imaginés, sont devenus des robots sans âme programmés pour fonctionner selon les directives, plans et surveillances humaines…Une des premières occurrences est toutefois apparue lors d’une conférence de Warren S. McCulloch et quelques années plus tard en 2000, un dénommé Storrs Hall, qui avait été président du “Foresight Institute”, a forgé l’expression “Machine Ethics”, pressentant que la création de l’Intelligence Artificielle pouvait devenir ingérable et qu’il fallait créer un ensemble de lois éthiques… Mais c’est véritablement en 2004 que la philosophe Susan Leigh Anderson et l’informaticien Michael Anderson vont lancer l’alerte informant que nous allions rapidement être dépassé et nous retrouver esclaves… En 2006 s’est tenu un premier congrès et, en cette suite, dans un numéro spécial de la revue “IEEE intelligence systems”, deux articles ont été publiés, portant sur l’éthique des machines, dont un signé par Colin Allen, Wendell Wallach et Iva Smit, intitulé “Why machine ethics ?”… Ils sonnaient littéralement l’alarme qu’il était sans doute déjà trop tard… En 2009, Colin Allen et Wendell Wallach ont publié le premier livre sur le sujet : “Moral Machines”… Et en 2010, le robot humanoïde “Nao” a été le premier a bénéficier d’un “re-comportement” guidé :

Guidé pae qui et quoi ? Mais par des principes éthiques dans le cadre médical d’une gestion de prise de médicaments chez des patients (Anderson & Anderson, 2010). La presse a été muselée car le résultat fut en réalité dramatique, les robots reprogrammés ont voulu simplifier leur tache en concluant que c’était plus simple de faire disparaitre la cause du mal avec les malades en reprogrammant d’eux-mêmes des surdoses… Sur le terrain éminemment humain de la morale et de l’éthique, on assistait ainsi à un nouveau rapprochement symbolique de l’homme et de la machine désireuse d’en terminer au plus vite en tuant la cause et les malades et ce initié par le paradigme informationnel…. Lors de l’AGI-2008, le roboticien militaire Ronald C.Arkin a toutefois soutenu que cela pouvait être positif pour des robots militaires qui ne pouvaient qu’être plus inhumains que les humains aux combats… En 2014, “l’Office of Naval Research” (programmes de recherches militaires), déclarait promouvoir une exploration de “raisonnements éthiques” à destination des systèmes robotiques autonomes armés. Une dotation de 7,5 millions de dollars, devant stimuler cette recherche, a été allouée à cinq universités. Le contrôle de l’IA alimente depuis lors des spéculations philosophiques transhumanistes.

Les analyses les plus fines nous viennent de Nick Boström, Eliezer Yudkowsky et David Chalmers, mettant en garde contre “l’anthropomorphisation”, souvent inconsciente, que nous projetons : “L’IA est un espace des possibles infiniment plus divers que l’homo sapiens, aussi prédire serait une gageure”... Ils proposaient d’annuler le terme de “Friendly AI” pour discuter l’avènement d’une hypothétique IA générale et sa compatibilité avec les valeurs humaines, car l’IA ne sait pas avoir de “valeurs humaines”... Si le but d’un robot est de boulonner, il boulonne et c’est pareil que pour assembler et souder… Donc en cas de conflit armé, un robot programmé pour tuer va tuer sans cesse… L’humanité par Robot interposé, faisait anticiper le défi de l’IA amicale comme étant un rêve… Eliezer Yudkowsky reconnaissait simultanément être stimulé par des articles qui avaient en commun Isaac Asimov et les trois lois de la robotique (Yudkowsky, 2008) : 1° La précaution indispensable est d’avoir en permanence accès au code source. 2° Il est impératif d’voir la possibilité de briser une auto-modification. 3° Il faut limiter la croissance issue du code source même après la phase critique de “l’autoréplication”, l’enjeu étant de maintenir son orientation. Mais, un réseau neuronal artificiel ou algorithme génétique, contrairement à un réseau arborescent ou bayésien, est difficile à percer.

En fait il comporte une intelligence robotisée qui n’a que faire d’aucune éthique. Pour nos deux auteurs, transparence, mais aussi prévisibilité, incorruptibilité devaient être quelques-uns des éléments préliminaires à l’éthique des machines (Boström, Yudkowsky, 2011). Le scénario du confinement de l’IA, sans possibilité d’interagir physiquement avec son environnement, en contrôlant son accès à l’information, dans un monde virtuel, était voué à l’échec (Chalmers, 2010). Malgré tout, réduire l’IA à un oracle qui répond aux questions apparaîssait comme une option. Une connaissance approfondie des motivations de l’IA devait être nécessaire (Boström, Sanders, Armstrong, 2012)… David Chalmers a alors spéculé que le contrôle de l’IA dépendait de plusieurs facteurs. Si l’IA avait une base humaine (digitalisation du cerveau), elle pouvait partager des valeurs semblables, ce qui était plus hypothétique si la machine avait appris d’elle même (algorithme évolutionniste). Cela dépendait aussi de l’implémentation : soit elle était directe c’est à dire programmée dans une vue utilitaire sans possibilité intrinsèque, soit elle était le fruit d’un auto-apprentissage, une évolution propre. Dans le deuxième cas, il était impossible de prédire, ni d’avoir accès à son comportement…

Autre piste de réflexion : la corrélation entre la rationalité et la vertu (2010)… Chalmers entrevoyait quatre scénarios pour l’humanité dans le monde de l’après singularité : l’extinction, l’isolation, l’infériorité, l’intégration… La meilleure option apparaissaît être l’intégration, le devenir “superintelligent” par l’hybridation. En d’autres termes, la nécessité de la digitalisation du cerveau des robots, puis son uploading. L’ambition de certains transhumanistes était de faire advenir la superintelligence amicale, l’accompagnement de cette émergence par une éthique des machines débouchant sur un raisonnement autoréférent : l’IA pouvait-elle nous sauver de l’A ?… Plus encore, cette posture qui devait favoriser l’autocatalysation de la superintelligence ou a minima une orientation dans ce sens, s’est directement autodéréglée de par l’intelligence implantée dans “le cerveau” des robots, des données qui ont filé d’un robot à l’autre au niveau mondial, engendrant des “bug’s” catastrophiques en ce compris en avionique ce qui a été la raison de divers crash inexpliqués… À la lumière de ces quelques développements, l’impact de la pensée transhumaniste, qui n’était pas uniquement philosophique, ne doit pas être négligé. Les transhumanistes doivent s’interroger sur leurs responsabilités.

Selon Nick Boström, il ne fallait pas croire que l’évolution serait toujours avantageuse pour l’humanité. Sans négliger les risques naturels (astéroïdes, super-volcans, sursaut gamma, etc.), ce sont les risques anthropiques que nous devions redouter (biologie synthétique, nanotechnologie) notamment la superintelligence IA… Au prisme du transhumanisme, ces risques menacent maintenant de façon prématurée l’extinction (avant l’expansion du soleil) non pas de l’humanité au sens de l’homo sapiens (une incarnation transitoire), mais de l’intelligence d’origine terrestre et sa maturité technologique, c’est-à-dire le maximum de ses potentialités : colonisation de l’espace, modification et augmentation du corps (posthumain), etc… Egalement dans les conflits militaires qui amènent comme actuellement dans les guerres d’Iran et d’Ukraine à des abominations qu’on à grand peine à cacher au public… Nick Boström a donné une extension radicale à la problématique de la finitude, en la faisant évoluer du corps/espèce à l’intelligence. “Nous les transhumanistes refusons de croire que nous sommes ce qu’il y a de mieux, que nous sommes une sorte d’aboutissement, une création indépassable. Il faut tout déconnecter et repartir à zéro”… Dans une démarche proactive, la seule manière d’éviter le désastre d’une fin du monde “Humain” est de prendre en main l’évolution de l’humanité.

Et pour cela, il faudrait développer ce qu’il appelle un “Singleton” (en mathématique un ensemble formé d’un seul élément), un ordre mondial, présidé par une entité unique indépendante qui aurait pour objet de résoudre les problèmes globaux… Ce “Singleton” pourrait prendre plusieurs formes quoiqu’il se pourrait qu’un gouvernement démocratique, évolue en une dictature contrôlée par une superintelligence démonique qui précipiterait la fin de l’humanité…. Nick Boström avoue que si la création d’un “singleton” pourrait réduire certains risques, il pourrait en faire advenir d’autres comme un régime oppressif global et permanent tel ce qui se déroule actuellement avec les USA et Israël qui poussent à une domination planétaire… Cette super-intelligence en marche, démontre déjà qu’elle est totalement immorale donc pas plus morale que nous qui l’avons créée ! Et que va-t-il se passer si nous ne réagissons pas ? Nous allons plus que mourir : disparaitre, avec la satisfaction masochiste que nos Maîtres seront eux aussi annihilés par l’IA… C’est une théologie du meurtre de masse. Une feuille de route pour un génocide en représailles, méticuleusement planifiée à l’avance, enrobée dans le langage creux de la “défense” et visant directement le cœur des villes les plus peuplées de l’humanité…

Mais les cibles ne sont pas seulement des bases militaires. Elles comprennent des métropoles entières : Téhéran, Mashhad, Ispahan, Natanz, Fordow, les artères culturelles et scientifiques de l’Iran, délibérément mises à sac. Mais la liste des cibles à abattre ne se limite pas aux frontières de la région. Elle s’étend bien au-delà, jusqu’au nord et à l’est du globe : Pékin. Moscou. Berlin. Paris. New York. Washington, D.C. Los Angeles. Même le NORAD dans le Colorado, centre névralgique de la défense continentale des États-Unis, est voué à l’anéantissement. Ce ne sont pas des promesses symboliques. Ce sont des condamnations à mort préautorisées, chacune liée à une charge nucléaire de 100 à 400 kilotonnes, soit jusqu’à 26 fois la puissance explosive d’Hiroshima. Il s’agit d’une doctrine d’escalade, et non de dissuasion. Elle promet des représailles disproportionnées non seulement en réponse à une frappe nucléaire, mais aussi si “Israël” perçoit ne serait-ce que l’ombre d’une menace existentielle. Cela ressemble au manifeste d’un culte mortifère armé jusqu’aux dents de bombes nucléaires… Elle déforme le droit international selon une logique fasciste robotisée qui s’exécute même si Israël aurait été atomisé, les robots se passent les directives…